|

|

(광고) 단통법 시대의 인터넷가입 가이드(ver2.0) (234) |

백메가 백메가 |

2015-12 |

1766359 |

25 |

2015-12

1766359

1  백메가 백메가

|

|

|

[필독] 처음 오시는 분을 위한 안내 (737) |

정은준1 |

2014-05 |

5240839 |

0 |

|

2014-05

5240839

1 정은준1

|

|

5634 |

(ETC) 구형 삼성노트북- Sens Q310 (11) |

전일장 |

01-27 |

2588 |

0 |

|

01-27

2588

1 전일장

|

|

5633 |

(ETC) 개인 홉 랩 작업 현황 업데이트 (11) |

송주환 송주환 |

01-20 |

3760 |

0 |

01-20

3760

1  송주환 송주환

|

|

5632 |

(Network) Cisco 2960L 허브 문의드립니다. (12) |

뮤노 |

01-18 |

2790 |

0 |

|

01-18

2790

1 뮤노

|

|

5631 |

(ETC) 서?버랙을 원룸에 두는 미친 짓을 한 사람 (39) |

Robelier |

01-09 |

4564 |

0 |

|

01-09

4564

1 Robelier

|

|

5630 |

(VGA) 라데온프로 WX9100 (9) |

2CPU최주희 |

2024-12 |

4370 |

0 |

|

2024-12

4370

1 2CPU최주희

|

|

5629 |

(CPU) AMD 9600X CPU 온도 모니터링 |

TubeAmp TubeAmp |

2024-12 |

4432 |

0 |

2024-12

4432

1  TubeAmp TubeAmp

|

|

5628 |

(ETC) Chi-Pi 구축기 (5) |

MikroTik이진 MikroTik이진 |

2024-12 |

4566 |

0 |

2024-12

4566

1  MikroTik이진 MikroTik이진

|

|

5627 |

(Network) 광 패치패널 작업용 OS2 파이버 (4) |

송주환 송주환 |

2024-12 |

4274 |

0 |

2024-12

4274

1  송주환 송주환

|

|

5626 |

(Server) 서버구성일지 2 (13) |

서버꿈나무 |

2024-12 |

5408 |

0 |

|

2024-12

5408

1 서버꿈나무

|

|

5625 |

(Server) 서버구성일지 1 (15) |

서버꿈나무 |

2024-12 |

4426 |

0 |

|

2024-12

4426

1 서버꿈나무

|

|

5624 |

(ETC) 오늘의 개인 서버실 작업 (9) |

송주환 송주환 |

2024-12 |

5396 |

1 |

2024-12

5396

1  송주환 송주환

|

|

5623 |

(PSU) 대량 HDD를 쓰기에 어떤것이 더 좋은 파워인가요? (12) |

왈사 |

2024-11 |

6249 |

0 |

|

2024-11

6249

1 왈사

|

|

5622 |

(ETC) 추억의 SOYO 미니피씨 (10) |

MikroTik이진 MikroTik이진 |

2024-11 |

6457 |

0 |

2024-11

6457

1  MikroTik이진 MikroTik이진

|

|

5621 |

(Network) Aruba Wireless Controller 7240 초기 구성 |

송주환 송주환 |

2024-11 |

5120 |

1 |

2024-11

5120

1  송주환 송주환

|

|

5620 |

(Mainboard) msi b650m mortar wifi 사용기 |

마나아라마나 |

2024-11 |

4460 |

0 |

|

2024-11

4460

1 마나아라마나

|

|

5619 |

(Controller) Adaptec ASR-6405E (2) |

박문형 |

2024-10 |

4412 |

0 |

|

2024-10

4412

1 박문형

|

|

5618 |

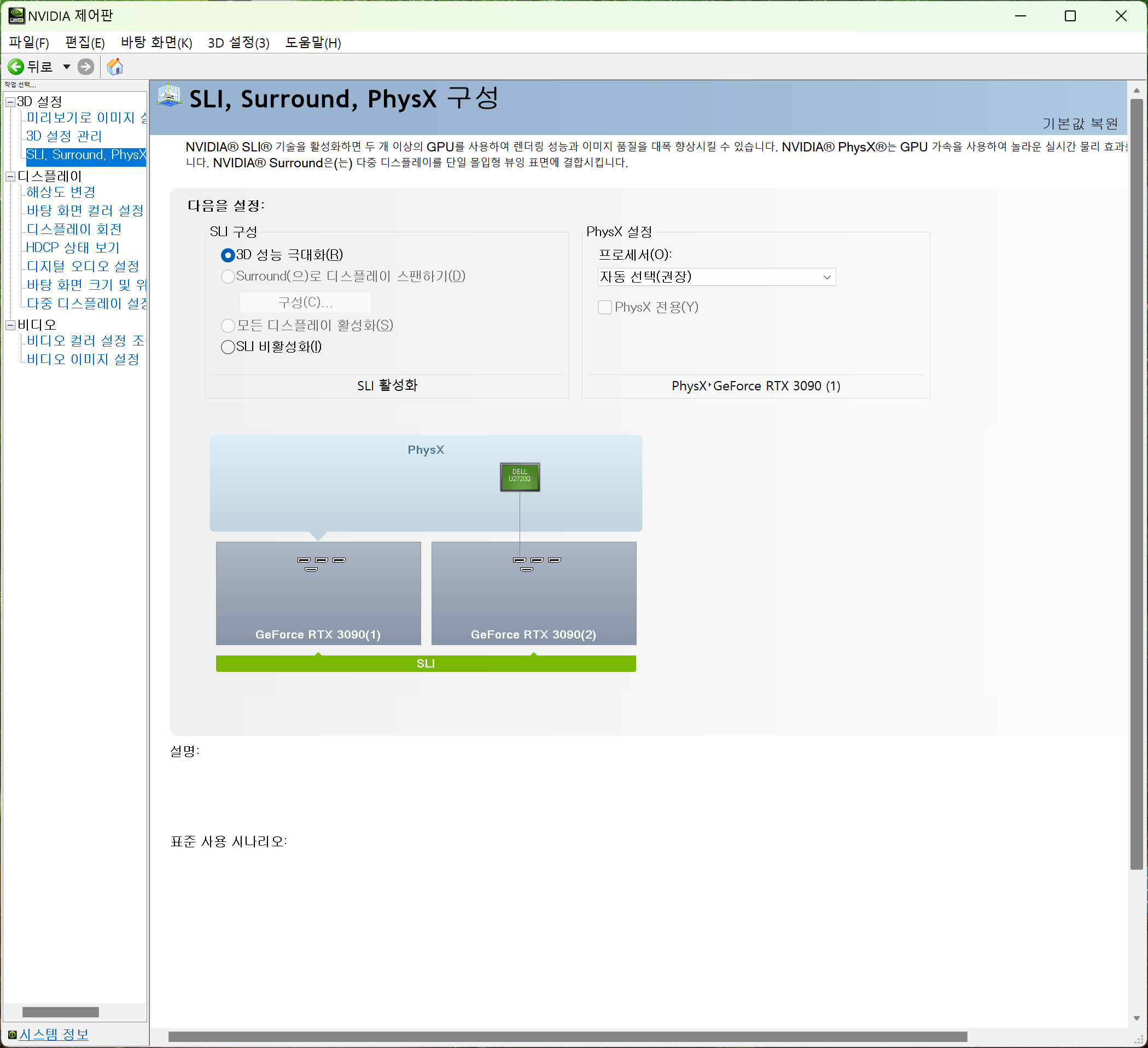

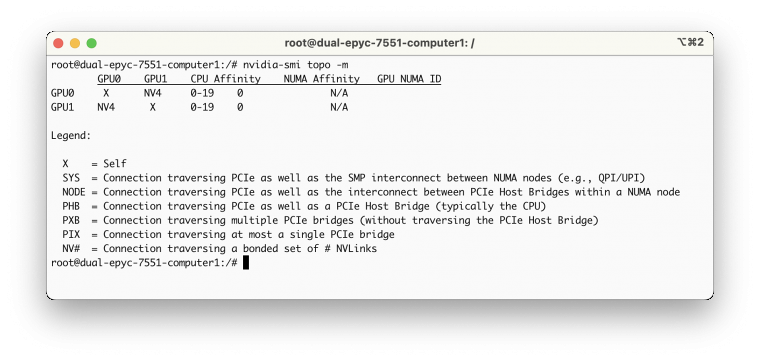

(VGA) 2개의 RTX 3090 NVlink 활성화 하기 @ Ubuntu 22.04 (3) |

TubeAmp TubeAmp |

2024-10 |

4244 |

0 |

2024-10

4244

1  TubeAmp TubeAmp

|

|

5617 |

(ETC) KVM 콘솔 대체를 위한 포터블 콘솔 이 일단은 정상 동작하는군요 (6) |

MikroTik이진 MikroTik이진 |

2024-10 |

2450 |

0 |

2024-10

2450

1  MikroTik이진 MikroTik이진

|

|

5616 |

(ETC) 전산실 데이터센터 엔지니어와 기존 랙마운트 KVM 콘솔 대체를 위한 포터블 콘솔 제… (25) |

MikroTik이진 MikroTik이진 |

2024-10 |

4437 |

0 |

2024-10

4437

1  MikroTik이진 MikroTik이진

|

|

5615 |

(Network) KT GiGA Fiber (해피전자 제조) 사진 (6) |

박문형 |

2024-09 |

4749 |

0 |

|

2024-09

4749

1 박문형

|

침이 질질나오네요.

일반 웹에서 사용하는거랑

로컬로 돌리는거랑 가장 큰차이 뭘까요?

리마같은거 돌리시는거죠?

A6000 이 벤치마크에서 초당 45 토큰 처리 능력이 있고 3090 2개 NVlink는 초당 18 토큰 정도 성능이 나온다고 합니다. LLAMA 를 돌리기 위해서는 A6000이 아주 좋은 선택이지만 배우는 입장이라 3090 2개 NVlink를 선택해 보았습니다.

저는 LLAMA 보다는 3차원 피부 주름 데이타를 pytorch 를 이용한 wavelet 분석을 해야 하기에 3090 혹은 4090 GPU 여러 개를 이용한 분석이 저의 경우에는 더 적합합니다.