어찌보면 당연한 건데 일기 느낌으로 초보가 깨달은 점을 적어 보고자 합니다.

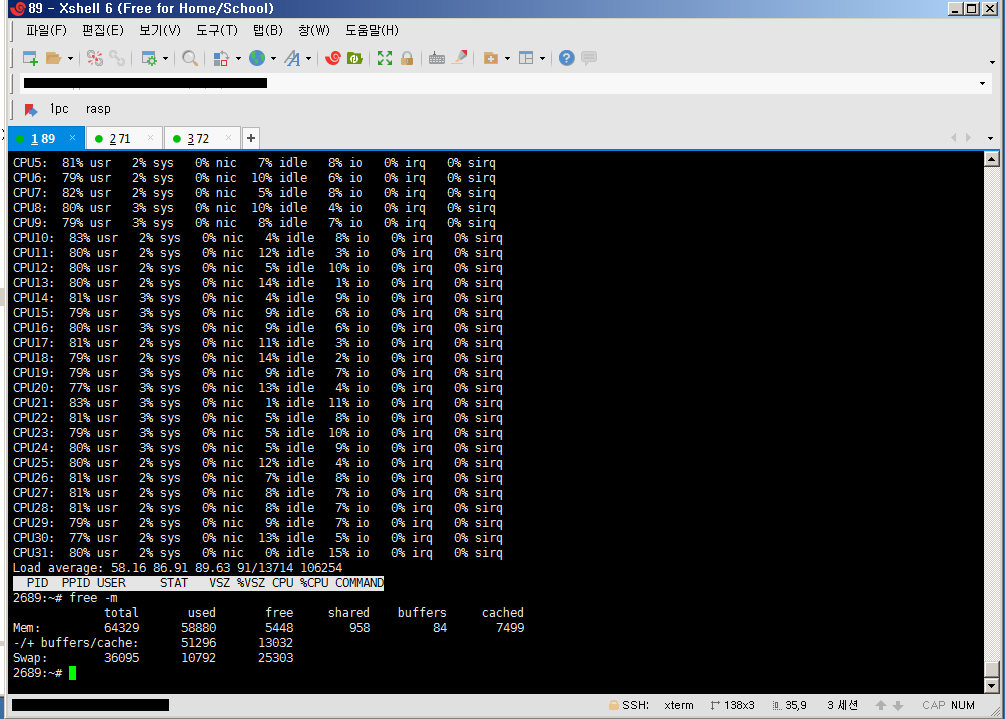

현재 2689v1 듀얼 64기가램 (레이드 카드 없음) 시스템 1개,

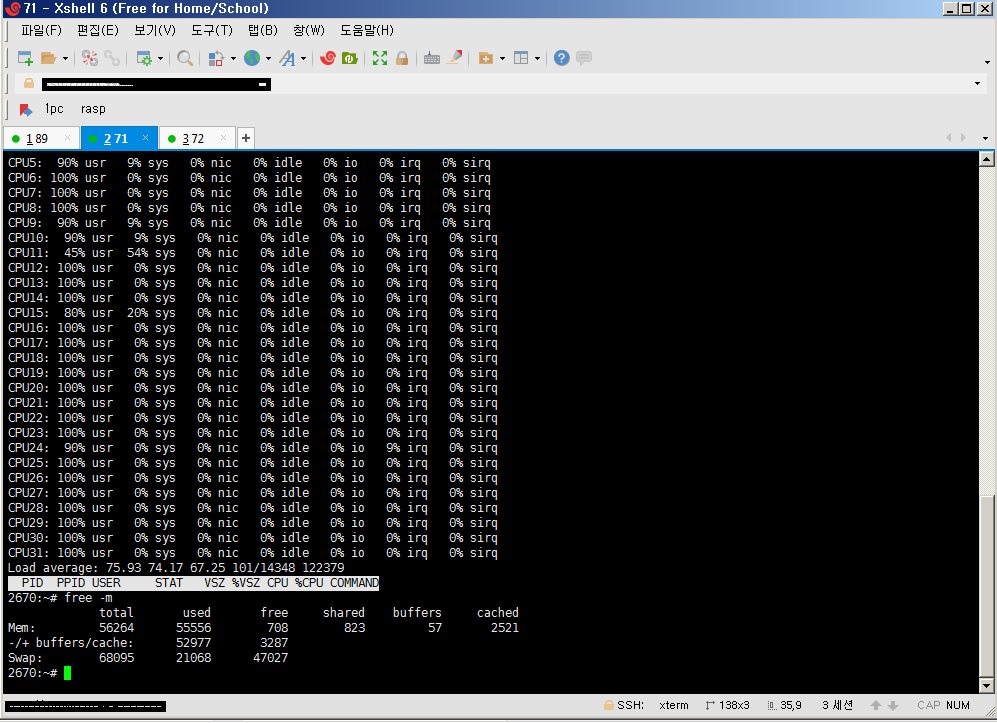

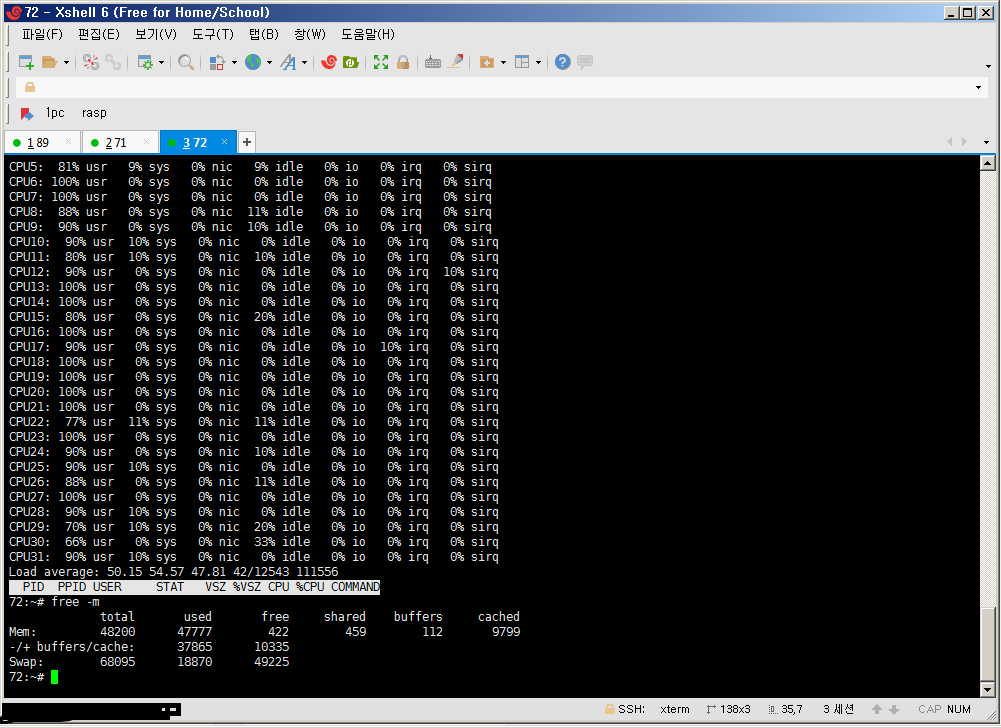

그리고 2670v1 듀얼시스템 48기가 램 (레이드 카드 있음) 2 개에 도커 컨테이너 여러 개를 돌리고 있습니다.

총 3개의 시스템인데요.

<그중에 2689시스템 빼고 2670 두 시스템만 레이드 카드에 ssd를 물린 상태입니다.

세 시스템 모두 swap파일을 ssd에 만들어 두어 활용하고 있습니다. (작업 중 램이 살짝 모자른데 컨테이너 몇 개 더 돌리자고 램 추가하긴 아까워 swap파일을 활용하고 있습니다.)>

자!

누가 봐도 2689시스템이 좀 더 원활해야 하지만 그렇지 않더군요!! 허헐..

(동일한)컨테이너 갯수로 비교하자면 2689는 57개에도 버벅이는 느낌이 발생하고 idle 상태인 프로세서 자원이 있음에도 그렇더군요..

2670은 idle이 없이 프로세서 자원 100%로 끌어다 써도 2689 시스템보단 원활합니다. 무려 62개가 동시에 돌아감에도요..

더 낮은 사양의 시스템이 더 많은 컨테이너를 수용해도 무리가 없는 상태인데요.

이유가 레이드 카드 사용 유무인 것 같습니다.

잦은 swap 파일 입출력에 따른 병목현상!!! 스샷을 각각 찍었는데요. 봐보세요.(참고로 알파인 리눅스 사용하고 있습니다. 윈도우 10에서 리눅스로 넘어왔는데.. 이건 또 신세계네요.. ㄷㄷ 별 차이가 없을 줄 알았어요. 해보니 엄청 차이가 크네요. 와..)

2689 레이드 카드가 없어 swap파일 활용시 병목 현상이 발생으로 추측

2670 시스템 io 거의 0%에 램이 56기가(48에서 4기가 짜리 두 개 달아 줌)임에도 2689 64기가램 시스템보다 원활함..

체감하기론 아예 램이 더 낮아도 swap파일 세팅만으로 무리없어 보임

2670 위와 동일 램만 48기가

레이드 카드의 사용 목적이 입출력에 따른 병목 현상을 없애는 게 주요하다고 보았는데 실제 체감했네요.

저는 단순히 프로세서 자원을 입출력이 점유하는 문제에서 끝나는 건 줄 알았는데(가져가서 병목현상 없게 잘 쓰면 문제가 없으리라 생각함. 프로세서를 덜 쓰면 되는 거겠지... 라고 생각함)

헌데 입출력이 프로세서 자원을 뺏어 먹는 건 둘째치고 뺏어 먹어도 프로세서 쓰레드들 idle 상태임에도 병목이 발생하더란 점.(이게 포인트..)

결론적으로 레이드 카드가 입출력이 잦을 땐 엄청 중요한 거구나를 깨달았습니다... (레이드 활용할 것도 아니고 이게 굳이 필요한가 싶었거든요;;)

(하는 작업에 따라 다르겠지만) 레이드 카드를 통해 스왑 파일로 스왑하면서 하니 램 부족도 전혀 무리가 없었단 결과네요..ㄷㄷ

레이드 카드 모델은 아마 이거일 거에요.(모양은 같은데 모델명은 정확치 않네요;;) 다른데선 현재 3? 만원 정도 최저가로 봤고요.

2689시스템에도 위와 비슷한 느낌의 것을 하나 달아줘봐야 겠네요.

감사합니다. (__) 일기 끝.

ij�� �� ���� ���̵� ī��� �� ���ϸ� �������� ���ؼ� �����ϴ�..

����ȭ �ý����� �Ѱ��� ������ �ý��ۿ� �������� �ý��� OS�� �Ѳ����� ���ư��� �������� ��ũ�� ��Ʈ��ũ I/O�� �������ϴ�..

���� ��� ������ �ϵ���������� ij�� �� ���̵� ���� �ʼ��Դϴ�..

���� �ϵ���� ij������ ������ �߿��ߴ� ���̾�����..

���� ���� ������ �����ϰ� �׳� �� �ǰ���? �;��ϴ� ������ �ٶ��� �ռ��� �����ε���. ���� ���� �ڴʰ� ���� �������� �� �ϳ� �� ����� �� �����ϴ�.

���μ��� �Ŀ��� ���ڸ��� �����ٵ� ���� �����ϱ� �ñ��ߴµ� �˷��ּż� �����մϴ�.(��� qna�� �ø����ٰ� ������ �ǵ���. ������ �κ��� ��.. ����)

���� ���� �ֱٿ� ���丮�� ����(���� ���� ��ħ�� �긮�� ��.. �Դٰ� ��ũ ���ݵ� ����)�� ������ ���� qna�Խ����� ���� �ִµ� �ڹ����� �۵��� ��¥ ū ������ �ǰ� �ֽ��ϴ�. �� �ڸ��� ���� ����帳�ϴ�.(__)

Ư�� ���ÿ� ����� ���ϸ�... ��������

�ٴ��ͷ����� �о���̸� �������� ����� �ʿ� �̻����� Ŀ���� �; ���� ���Ϸ� �غ��� �Ǿ��µ�

���� ��� ���� 100%�̰� �� ���� ������ �Ƴ��� �� �����.

������� ���ÿ� ������� ���ϴٺ��� ���̵� ī�� ��� ������ ���� �� ����������..

���� ����Ǵ·��̵� ī����� ������� ���� ����ȭ �Ǿ�� �����̶����?

��ũ I/O �����ϰ� �ִ� �κ��ε���.(���� �������� ���ߴµ�;) ���̰� �� �״�� �� �ϴ�����. �װ� �� �뷮 ���������� �Ἥ ��������;

���� �ϴ� �� ��ũ�� ���Ⱑ ���� �����ε���. ���̵� ī��(ij����?)�� ��û ������ ó���ǰ� �ִ� �� �����ϴ�( ij������ ���� I/O �� �ϴ� ��..)

�̷ν� �������� �Ŵ��� �� �뷮�� ���� �� ���� �����̿���. �Ϲ��� ���� ���̵� ī�� ���� ���� �ý��۵��� �� SSD�ӿ��� ���ư��� ���µ� ���μ��� �ڿ��� �˳��ص� ���ҵǸ鼭 �����̳�. I/O�� ������� �����ϴ� ���̰� ���پ��ϰ� �ѻ纮�� �� �����ϴ�. ��·��, ���̵�ī��� ��.. �� ���� �ſ�����+_+

��� �� �� ����� ���� �ڰ� �̰� �� �Ѱ��� �Ͱ�;; ������ �� ����. ã�ٺ��� ���� ������� ���̵� ī�嵵 �� ������ �ǰ� �Ͱ���

������� ���� ����ȭ�� ���� ij���� �ְ� ������ ���̴� �͵鵵 5���� �����̶� �δ㵵 ���� ���̳�. ������ ij�� ū �ŷ� ã��������.

���̵� ī�� ���� ��ǰ�� ���� �� ���� �غ��� ���ϳ�...

���� ������ �ϵ���� ij�� �� 8CH�� �� �ʸ��� (50-90)�� �̰� 24CH���� 200�����밡 �Ѿ�ϴ�..

���̵� ī��� ���� ��� ���Դϴ�..

��� �� ���丮�� ���� �����غ����� �����ϰ� �ֽ��ϴ�. �ڹ����� 24bay���丮�� ���� ���� �˻� �ҽ��ϴ�.(��õ)^,~

������ �׳� �̴�ε� �뵵�� �������� �ʾ�(�����̳ʵ� ������ �� ��Ƴ����� ���ļ���) ���ٰ� ��� �ý��� �ٲ㺸�鼭..

��ǥ��� ���� ���̵� ī�嵵 �˾ƺ��� �Ẽ�� �մϴ�. ���� �����մϴ�.

�� �ý����� ��� ������ SSD����, RAID ī�忡 ���� SSD���� ��� RAID�� ���� ������ ���

����ӽŵ��� SSD�� ��ġ�� ������, ����ӽŵ��� �ϵ��ũ�� ��ġ�ϰ� SWAP ���ϸ� SSD�� ���� �������� �ڰ���.

RAID ī�� cache�� 1GB �������ٵ� �װ� ���� ȿ���� �� ������ �ǹ��Դϴ�.

�ڹ����Բ��� SSD�� ���� ��Ƽ IO�� ���ϴٰ� �ϼ̴µ�, SSD�� ���� ���� �ٷ� �����Դϴ�.

7,200RPM�ϵ��ũ���� 15,000RPM �ϵ��ũ�� ���� ���� �� ���̰�, 15,000RPM �ϵ��ũ���� ���� ���� SSD�Դϴ�.

�ϵ��ũ ���ʰ��� RAID0���� �����ص� ���� SSD �ϳ��� �����մϴ�. SSD �߿��� ���� SSD 10���� RAID 0���� ��� ���� ������ ���� ���� SSD �ϳ��� �����մϴ�.

E5-2689 V1�� E5-2670 V1�� �������� ����ӽ��� �����ٰ� �� �� �� ū ���̸� ���̱�� ��ƽ��ϴ�. ����� ����

E5-2689 ���� RAM�� ������ �翬�� ����

3�뿡�� ����ϴ� SSD�� ���� �������� RAID�� ��� ���� ������ �ñ��ϳ�. RAID ī�� cache�� ������ �����ߴٰ� ���� ����� ��Ȳ�̶�.

RAID�� �����ٰ� �ϴ��� cache ���� RAID ī�峪 ����Ʈ���� RAID�� cache �ִ� RAID ī�峪 RAID 0, 1, 10������ �� ū ���̸� ������ �ʽ��ϴ�. RAID5, 6, 50, 60���� �ſ� ū ���̸� ���̴µ���. SSD�� RAID 5, 6, 50, 60 ������ ���� ���ΰ���? �Ͽ��� �ñ�

�ݰ����ϴ�.(__)

���� �ٸ� ������ �������.. �� �� ���ϰ� ����ڽ��ϴ�. �߰��� �� �Ǿ��� �κе� ������ �˷��ֽʽÿ�.

�� �ý��ۿ� SSD �ϳ����� ���ְ���.(�� �ܼ��մϴ�;)

2670�ý��۵鸸 ���̵�ī��(rms25cb040)�� ���� �������̺�� ��Ƽ� ���� �ֽ��ϴ�.

OS�� ��Ŀ �����̳ʵ�, ���� ���� ��� �ϳ��� SSD�� �ְ���.

��ũ�� �����ϴ� ���������� ũ���

2689 �ý����� �� 36G�� ���� ���� ũ�⸦..

2670�� �� 68G�� ũ���Դϴ�.

SSD ����,

2689�� v-nand ssd 850 120GB

2670�� �� �� v-nand ssd 860 EVO 250GB

�Դϴ�.

(�б�� �����ϰ�)���̵� ī�� ���μ����� ij���� Ȱ������� ���� ���� ����� �� ���������� �� �ƴѰ���.

(�ӵ��� ����)ij�����ٰ��� ���� I/O��, ������ ����(���� ��ũ�� ���)�� ���̵�ī�� ���μ����� ó���ϰ� �Ǵ� ������ �����ؼ���.

���� �䱸 �뷮�� ���������� ij�� ũ�⸦ ���� ������ �ƴ� �� ���� �� ����̶�� ����(����¡)�Ǵ� ������ ��(������ ij��)������ ���� �ӵ��� �����ϰ� �� �� �ƴѰ� �����ϰ� �ֽ��ϴ�. (SSDij�� ũ��� ��Ʈ�ѷ��� ��Ÿ �������� �ֱ� �ѵ� ����� ���̵� ī�� ��� ������ ������ �ֿ��� ������ �ƴѰ� �����߽��ϴ�.)

��ũ�� ij�ð� ���̵� ī���� ij�� ��� ������ ���� ��Ÿ���� �� ���ÿ� ������ �� (��Ʈ�ѷ���) ó�� �ӵ� ���̰� �ƴұ� �Ͱ���.

���̵� ī��� "A�� ����� �� ��, B��, C��,..FGH.. �������� ���� ���� ���� ���μ������.. �� ���߿� ���� ��ũ�� ��¦�Ұ�"(���� ������ ������ �ǰ�..)

��ũ�� "A �� �����.. �� ��� ���ÿ� ������.. ��..B���� ���� ���� D�� ��ٸ����.. C����.. �� ���۰� ���� �־�.. A ��Ϻ��� �ϰ� �ð�.. (���뿡�� GG) ���.. ���� �ϳ��� ���� �� ȿ���� ������.."

�鼭 �׳�.. ��� �̴ϴ�;(--);;������. �̷� �������� ������ �ֽ��ϴ�. �����Ե� �Ž����� ���� ��Ź�帳�ϴ�.(�ʹ� �밨�ϰ� ����; ���� ��������?

�̷� �����̶�� CPU�� �Ϻ��� ���� �����ؼ� ���� ���̵� ī��(��ũ I/O����)�� �س��� ���� �� �� ���� �� ��������.. ���� ���� ���� �ʳ���..)

�������ֽ� ���̽���� �ǰ� �����մϴ�.

�������� ij�� ���� ���̵� ī��鵵 �� ���ƴ�����? �� ����..; �����Ǵ� ���̵� ����� ���ݾ� �ٸ����� ������ ���߷��� ������(���� ij�ð� �ʿ����) �ϱ��. ���� ���ڸ�, �������ֽ� ij�� ���� ���̰� �̹��� ���̵� ��Ŀ���ó�� �Ƹ� �� ���̵� ����� ��ũ�� ��Ʈ�ѷ� �� ij���� ������ (Ȱ��ȭ)�л� �����(Ư¡)���� �ؼ� ����(���̵� ī�� ij�� ����)�� �̹��ϰ� ��Ÿ�� �� �ƴұ� �Ͱ���. �̷� Ư¡�� ��ĸ� ������ ��� �߰� ij���� �߿䵵�� ���� ���� ���̰���. ���.. ���� �ѹ��� ���̵�� ��� ���� ����..(�̰� ���� ����?���� ������ �ִ� �����Դϴ�.) �غ� �� �� �����ϰڽ��ϴ�. ������ �Ǿ����ϴ�.(__) ��.. ����ħ��..

���п� �� �� �����غý��ϴ�.����

��, QnA���� �˰ڽ��ϴ�.�� ��Ű �� ���� �ðԿ�..

���� �Ϸ� �ǽʽÿ�.

�� �ý��ۿ��� 120GB SSD�� �Ұ�, �� �ý��ۿ��� 250GB SSD�� �Ҵµ���. spec���� �� ���� ���̰� ũ�� ���ϴ�.

Samsung 850�� 860�� ���� ���̰� ���� �����ϴ�. 850�� 860 ���̰� �ƴ϶� 120GB�� 250GB ���̿� ���� ���̰� Ů�ϴ�.

SLC ���� �������� �뷮�� ������� ������ ������ �� ������ �����

sequential write ������

120GB - 150MB/sec

250GB - 300MB/sec

500GB - 500MB/sec

4K random write ���ɵ� ���������� ���̰� ���ϴ�.

�뷮�� ���� ���� ���̴� enterprise SSD�� �ƴ� consumer SSD������ ���� ��Ÿ���� �����Դϴ�.

swap ������ ��쿡�� sequential write���� random write ������ ũ�� ������ ��ĥ ���Դϴ�.

���� : Anandtech�� 850evo review

https://www.anandtech.com/show/8747/samsung-ssd-850-evo-review

* 850�� 860 ���̴� ���� �����ϴ�. �뷮�� ���� ���̸� �ָ��ϼ���.

������ 120GB SSD�� 250GB SSD�� ���� ������ �־��ٸ� �����ִ� �뷮�� 120GB�� ��쿡�� ���� ���Դϴ�.(SWAP ���� ũ�Ⱑ �ٸ���� ������ �װ� �����ص� 250GB SSD�� ��� �����ִ� �뷮�� �ξ� Ŭ ���Դϴ�. consumer SSD���� �����ִ� �뷮�� ���� ��쿡�� ������ �϶��ϴ� ���� �����Դϴ�.)

����Ͻô� �뵵�� �´� SSD���

1. enterprise�� SSD

2. consumer�� SSD��� �����̳� �Z ��

3. consumer�� SSD��� ������ �� �뷮�� ū ��(�ּ� 250GB �̻�)

�̷� ������ �����ô� ���� �����ϴ�.

���� �뷮�� �˳��ϴٸ� overprovisioning�� �� �� ����ֽø� 4K random write ������ ũ�� �����մϴ�.(SWAP ���Ͽ� �߿�)

���� ��� 250GB��� 50GB�� �� overprovisioning�Ͽ� 200GB ¥���� ����� ���� ���Դϴ�.

���� ��ũ�� Anandtech review�� �������� overprovisioning�� ���� ���� ���̸� ���� �� �ֽ��ϴ�.

�˷��ֽ� ������� �Ƴ����� ��縦 ���� ���� ó�� ���� SSD�� ����� ����� ���� �Z�����ǿ��� ���� �� ������ ������ ���ذ� �˴ϴ�.

(��ҿ� �˾Ƶθ� �����ٵ�;; ��ҿ� �˱Ⱑ �ȴ������;;)

���� �ͺ�����Ʈ ����� ���� ������ ����-���κ����� ������ 1/3 ������ SLC����ó�� ������ ���۷ν� ����� ���� �ӵ��� ����Ű�� �ű���.

�Ŀ� �ٸ� �������� �Ű�������. �Ϳ�.. �ͺ�����Ʈ ������ �ƴ� ������ ������ ���� �� ���� �ֽ��ϴ�. ����..�ϰ� �׳� �Ѱ�µ���. �̰� �ǹ��ϴ� �ſ�����.

SSD�� �׳� ������ �� ���� ������ �ּ��̰��� �; ���� ������ ������;;�Ф�(�ٳ��Ϳ��� ���� SSD�� �������� ���� �� �Z�̸� �ȴٰ� ������..)

��.. �Դٰ� ����, ���� ������� �� ����� Ȱ��ǰ� �ֱ���. �� ������ �� �������� TLC �ӵ��� ���ƿ�����.

���� ���� 850�� 860�� �� �κп��� ���ǹ��� ������ ���̰� �ֳ�.

���� �� �ý��ۿ��� 850�� �ͺ�����Ʈ ������ 3G�� ������ �������� 860�� �ű�� Intelligent TurboWrite�� �ʿ�� 9G�� �߰��Ǿ� �� 12G�� �ͺ������� �������� �˾Ƽ� Ȱ���� �Ǵ� ����.

���� PC�� ���� ij��&������۷� ���� �����(���� ���� �̷� �� �������� �����µ�) �װ� ���ǵ� ��忴����.

�����ǿ��� �� �� �����ϴ�. ���� ������ ���� �ǰ� �; �����ؼ� ��ġ ������ ��ġ�� �ʹ� ���� �̻��ϰ� ���Դ� ����� �ֳ�.

�ٺ������� �뷮���� �������� ���ϴ� ������ �˰��� �־����� ������ �� �������ϴ�.

���� ã�ƺ��� ä�μ� ���̷� ���ķ� ó���� ����� ������ �����ϴ� �ű���.

�������� �� ���� �� 850 120G�� ���ߴµ���. �Ŀ� �� �� �ȵǼ� 860 250G�� �������� �̹�����������;(����)

�������� ���� ��� �����մϴ�. ��¥ ���п� SSD�� ģ���� �� �����ϴ�. ��� SSD�ϱ�.. ���ٴµ�.. �׳� �˾Ƽ� �� �ϰ��� �;��µ���.

���� �� �ؾ� �Ǵ� �ű���.. ���� ���п� ����ȭ�� �õ��غ� ������ ���� �� �����ϴ�.

�˷��ֽŴ�� �������κ����� ���� Ȯ��&���ǵ� ��� Ȱ��ȭ �������� �ѹ� �õ��غ��� �ڽ��ϴ�.(__)

���������� ���� �ϳ� �����ؾ� �ڴµ���.

�� ������ ���̰� ���̵� ī�� ���̳� SSD ���̳ķ� ������ ��е� �����ε���.(�� ������..��) �����..

�����е� ������ ������ ����ڽ��ϴ�... (���� �ḻ)

(������..)

���� �� �ٶ�� �����մϴ� '_'

������ SWAP�� ���� ���� Memory Access �ӵ��� 20�� ������ϴ�.

SWAP DISK�� RamDisk�� ����� ����ص� 20�� ������ϴ�.

SWAP DISK�� SSD, RAID �Ʒ� SSD �� �� �ʿ�����ϴ�.

SWAP�� ������ ���ؾ� �մϴ�.

Ư�� ram�� �Ϻθ� ram disk�� ����� �ű swap ������ �ִ� ���� �� �����ְ� ��� ����Դ� ��.

����� ���� ���� ���� �ٽ� ��� ���⿹�� ��� ���� ���� ���� ������ ���� ���� ���� ���� ������ �� �� �������� ���̳� ��������. ��

���� ram ������ SSD ������ �δ� swap ������ ������ �� ���� �ֽ��ϴ�.

ram�� 80gb �����Ǿ� �ִµ� ��ҿ� ram �䱸���� 100gb �� �Ǿ� �� swap ���� ������� �ִ� ����� �翬�� ram�� 128gb ������ �ø��� ���� �½��ϴ�.

���� 80gb �����Ǿ� �ִµ� ���� ���� 60gb �̸����� ����ϰ� ��¼�� �������� ram �䱸���� 100gb ������ �þ�� ����� 4k ������ ���� ssd�� swap ������ �־� ����ϴ� �͵� ������ �� ���� �̴ϴ�.

�� ū ������ SWAP�̶�� ����� �ʹ��� �Ҿ��ϴٴµ� �ֽ��ϴ�.

HW ���� ȿ�������� ���� ��Ȥ �ʿ��� �� �뷮�� ���ؼ� ���� �� �����ϴ°� ���ٴ� ���� ������ SSD ������ SWAP�� ����� ����ϴ°� ���ƺ��� �� �ֽ��ϴ�.

������ (����̶��) ��ü���� ��ȸ����� �ʹ� Ů�ϴ�.

SWAP�� ���� ���� ��ü �ý����� ������ ��� �������� ��������� �ش� VM���� ���ư��� �۾� response �ð��� ���� ������ �Ұ����� ���ϴ�.

�־��� ��������� SWAP ����߿� HW�� ������ ���ؼ� ���߱�� �ϸ� VM ��ü�� �ս��ϴ� ��쵵 �ٹݻ� �Դϴ�.

���� ������ VM Hypervisor���� SWAP�� ���ϴ°� ������ ���ƾ� �մϴ�.

��¦�� �� �����Ҵµ���. �����̳ʵ��� �÷����� ���� swap �������� �÷����� ������ Ȯ���� �ֳ�.

2670 �ý����� 48�Ⱑ¥���� �����̳ʰ� ��� 58�����µ���. (�����̳ʴ� �� �䱸�� ���� �þ 1�Ⱑ ���� �ѰԱ��� ���˴ϴ�.)

���⼭ 4���� �� �߰����� ���ε� ���� �ý��ۿ� ���� 8�Ⱑ ���� �ý���(62���� ������)�� ���ư��� �� �ȵdz�.

���� ���Ϸ� IO���� �� idle ��ġ(���Ÿ�� ���μ����� ��)�� �ö�(*���� �̰� �� �ڿ��� �� �˾ҳ�;;) ����¡�� �ɸ�������.

�� ���� �ٸ��� ���������� �ʾƿ�;

������ֽŴ�� ����̳� ��� ����� ���������� SWAP�� ���ϴ� �� ������ �� ������ �Ǿ�����.

�߰��� �������� ������� ���� ���Ϸ��� ������ �䱸���� ���� �� ������ ������ �����Ͽ� ���������� ���ÿ� ������ �� �����ϴ�.

�ٺ������� swap������ epowergate���� ������ ȯ����� �ּ̳�. �����մϴ�.

���� ��� ���Ҹ����ε� �뵵�� ���� ����� Ŀ���� ������ �ڴٴ� �ٶ��� �ϴ��� ���� ������ ���ܵξ�� �ڽ��ϴ�..;_;

(�ϴ����̶� �� ��.. �̷��� ���� ���� ������; õõ�� ���ҵǸ� �� �͵� ��������..

���ڱ� '��'�ϸ鼭 IO��ġ�� 0%���� ���ÿ� �ö� Ȯ Ƣ�� ����������. ���� �׳� ���ݾ� ���ݾ� �������� ���� �� �͵� ������ ���Դϴ�..

���̵� ī���� ���ص��� SSD�� ���õ� ���� ������ ��� õõ�� �ϰ� �����̳� �� ��� ��ȹ�� ���� ������ Ʃ���غ��� ��� �� ���� �� �����ϴ�)

�����մϴ�.

�� ��� ���� �Ϸ� �ǽʽÿ�.(__)